基于树莓派视觉识别的柔性采摘机器人设计

作者: 李庆宇

摘要:本研究设计了一种基于树莓派视觉识别的柔性采摘机器人,通过视觉识别、路径规划、采摘控制与远程监控等功能模块的协同工作,实现了果实的精准识别与无损采摘。系统采用树莓派4B主控单元、Intel RealSense D435i深度摄像头、UR3e机械臂及OnRobot RG2夹爪等硬件,结合YOLOv5、A*算法、PID控制算法及MQTT协议等技术,显著提升了采摘效率,保证了果实完整性。测试结果表明,系统在视觉识别精度、路径规划效率及采摘成功率等方面均达到预期目标,为农业自动化提供了可靠的技术支持。

关键词:树莓派;视觉识别;柔性采摘机器人;路径规划;农业自动化

中图分类号:TP3 文献标识码:A

文章编号:1009-3044(2025)09-0022-03 开放科学(资源服务) 标识码(OSID) :

0 引言

随着农业现代化的推进,采摘机器人成为提高农业生产效率的重要工具。然而,传统采摘机器人在灵活性和适应性方面存在不足,难以应对复杂多变的果园环境。基于树莓派的视觉识别技术结合柔性机械臂,为解决这一问题提供了新思路。树莓派作为一种低成本、高性能的嵌入式计算平台,能实现高效的图像处理与目标识别。柔性机械臂则可适应不同果实的形状和位置,实现精准采摘。本研究旨在设计一种基于树莓派视觉识别的柔性采摘机器人,以提高采摘效率和保证果实完整性,推动农业智能化发展。

1 需求分析

1.1 功能需求分析

基于树莓派视觉识别的柔性采摘机器人须具备精准识别、路径规划、避障导航、采摘控制及远程监控等功能。视觉识别模块应能准确识别果实位置与成熟度;路径规划模块需实现高效移动与避障;采摘控制模块需协调机械臂与夹持器完成无损采摘[1];远程监控模块应支持实时数据传输与状态反馈。系统还需具备环境适应性,能在复杂农田环境中稳定运行。

1.2 性能需求分析

机器人需满足高精度、高效率与高稳定性的性能要求。视觉识别精度应达到毫米级,确保果实定位准确;路径规划与避障响应时间需控制在毫秒级,保证移动流畅;采摘动作控制须具备高协调性,确保采摘成功率;系统整体功耗应优化,支持长时间连续作业。机器人须具备较强的环境适应性,能在不同光照、地形条件下稳定运行。

2 设计方案

2.1 机器人软件功能模块设计

2.1.1 视觉识别与果实定位功能模块

视觉识别与果实定位功能模块基于树莓派开发,采用OpenCV(Open Source Computer Vision Library,开源计算机视觉库) 和YOLOv5(You Only Look Once ver⁃sion 5,单阶段目标检测算法) 实现果实识别与定位。

首先,树莓派连接的摄像头采集农田环境图像,利用OpenCV对图像进行预处理,包括去噪、灰度化、边缘检测等操作,提升图像质量[2]。随后,YOLOv5算法加载预训练的深度学习模型,对图像中的果实进行目标检测,识别果实的类别、位置及成熟度。果实定位功能计算果实中心点坐标,结合深度摄像头获取的距离信息,生成三维空间坐标,为后续路径规划提供数据支持。模块还设计了光照自适应算法,能在不同光照条件下保持较高的识别精度,确保系统在复杂农田环境中的稳定性。

2.1.2 路径规划与避障导航功能模块

路径规划与避障导航功能模块基于A 算法(Astar Algorithm,启发式搜索算法) 和DWA(Dynamic Window Approach,动态窗口法) 实现。模块首先根据视觉识别模块提供的果实位置信息,结合机器人当前位置,利用A算法规划从起点到目标点的最优路径。A*算法评估路径代价函数,综合考虑路径长度与障碍物分布,生成一条高效且安全的移动路径[3]。避障导航功能利用DWA 算法实时处理激光雷达(LIDAR,Light Detection and Ranging,光探测与测距) 传感器采集的环境数据,动态调整机器人移动方向与速度,避免与障碍物发生碰撞。模块还集成了SLAM(Simulta⁃neous Localization and Mapping,同步定位与地图构建) 技术,实时构建农田环境地图,提升路径规划的精度与适应性。

2.1.3 采摘动作控制与协调功能模块

采摘动作控制与协调功能模块基于PID(Proportional-Integral-Derivative,比例-积分-微分) 控制算法和ROS(Robot Operating System,机器人操作系统) 实现。模块首先根据视觉识别模块提供的果实位置信息,生成机械臂的运动轨迹。PID控制算法调节机械臂关节电机的转速与角度,确保机械臂能精准移动到目标位置。采摘动作协调功能通过ROS的多节点通信机制,实时同步机械臂与夹持器的动作,确保采摘过程的流畅性与稳定性[4]。模块还设计了力反馈控制算法,力传感器实时监测夹持器的夹持力度,避免对果实造成损伤。采摘完成后,模块自动生成返回路径,确保机器人能高效返回起始位置。

2.1.4 数据通信与远程监控功能模块

数据通信与远程监控功能模块基于MQTT(Mes⁃sage Queuing Telemetry Transport,消息队列遥测传输) 协议和WebSocket技术实现。首先,树莓派的Wi-Fi 模块与远程服务器建立连接,利用MQTT协议实时传输机器人的状态数据,包括位置信息、传感器数据、任务进度等。远程监控功能利用WebSocket技术实现双向通信,用户能在Web界面实时查看机器人运行状态,并发送控制指令[5]。模块还设计了数据缓存机制,在网络不稳定时临时存储数据,确保数据的完整性与可靠性。远程监控界面支持可视化展示,用户可在地图查看机器人位置,在图表分析中看到任务执行效率,提升系统的可操作性与用户体验。

2.2 机器人硬件行动模块设计

2.2.1 树莓派主控单元

树莓派主控单元采用树莓派4B(Raspberry Pi 4Model B) 作为核心控制器,配备4GB RAM(Random Access Memory,随机存取存储器) 和64 位四核ARMCortex-A72处理器,主频为1.5GHz。选择树莓派4B 的原因在于其高性能计算能力与低功耗特性,能满足视觉识别、路径规划等复杂算法的实时运行需求。树莓派4B 支持双频Wi-Fi(Wireless Fidelity,无线保真) 和蓝牙5.0(Bluetooth 5.0) ,确保机器人与远程监控系统之间的稳定通信[6]。树莓派4B 提供丰富的GPIO(General Purpose Input/Output,通用输入输出) 接口,便于连接各类传感器与执行器,为系统扩展提供灵活性。主控单元还配备了散热风扇与金属外壳,确保长时间运行时的稳定性与可靠性。

2.2.2 视觉传感器模块

视觉传感器模块采用Intel RealSense D435i深度摄像头(Depth Camera) ,支持RGB(Red Green Blue,红绿蓝) 图像与深度信息的同步采集。D435i的深度感知范围为0.2m 至10m,分辨率为1280×720,帧率为30fps(Frames Per Second,帧每秒) ,能满足农田环境中果实识别与定位的高精度需求。选择D435i的原因在于其内置IMU(Inertial Measurement Unit,惯性测量单元) ,能实时校正摄像头姿态,提升图像采集的稳定性。摄像头通过USB 3.0接口与树莓派连接,确保数据传输的高效性。视觉传感器模块还配备了遮光罩与防水外壳,适应复杂农田环境中的光照变化与湿度条件。

2.2.3 多自由度机械臂模块

多自由度机械臂模块采用UR3e(Universal Robots3e) 协作机械臂,具有6个自由度,最大负载为3kg,重复定位精度为±0.03mm。UR3e机械臂内置力传感器,能实时监测末端执行器的受力情况,确保采摘动作的精准性与安全性。选择UR3e的原因在于其轻量化设计与高灵活性,能适应不同高度与角度的果实采摘任务。机械臂的Ethernet(以太网) 接口与树莓派连接,支持实时控制与状态反馈。模块还配备了防尘与防水保护装置,确保在农田环境中的长期稳定运行。

2.2.4 柔性夹持器模块

柔性夹持器模块采用OnRobot RG2 柔性夹爪(Flexible Gripper) ,最大夹持力为40N,夹持范围为0mm至110mm。RG2夹爪内置力反馈控制功能,能根据果实的大小与硬度自动调节夹持力度,避免对果实造成损伤。选择RG2的原因在于其高适应性,能夹持不同形状与大小的果实,如苹果、番茄等。夹爪基于Modbus RTU(Remote Terminal Unit,远程终端单元) 协议与树莓派通信,支持实时控制与状态监测。模块还设计了防滑橡胶垫与自清洁功能,确保夹持过程的稳定性与卫生性。

2.2.5 移动底盘与驱动模块

移动底盘与驱动模块采用TurtleBot3 Waffle Pi移动机器人底盘,配备两个DYNAMIXEL XM430-W350 驱动电机,最大扭矩为3.0N·m,最高速度为0.22m/s。底盘采用四轮驱动设计,配备全向轮(Omni Wheel) ,能在复杂地形中灵活移动。选择TurtleBot3 Waffle Pi 的原因在于其开源性与可扩展性,便于与树莓派系统集成。底盘内置IMU与编码器,能实时监测机器人的位置与姿态,支持SLAM(Simultaneous Localization and Mapping,同步定位与地图构建) 功能。模块还配备了防尘与防水外壳,确保在农田环境中的长期稳定运行。

3 测试分析

3.1 搭建测试环境

测试环境搭建在模拟农田场景中,包含不同光照条件(晴天、阴天) ,自然光照强度的变化会直接影响视觉识别模块的成像质量,通过调节LED补光灯组模拟不同光照强度,可测试系统在20000~50000lux光照范围内的适应性。地形条件设置平坦地面与15°坡道,主要考虑到实际果园中常见的坡度差异,机器人需在负载2kg果实的情况下完成±15°坡道的稳定行走,同时验证路径规划算法在不同地形下的调整能力。果实分布密度设置稀疏(间距≥80 cm) 与密集(间距≤30 cm) 两种模式,机械臂末端的激光测距仪实时检测果实间距,评估系统在不同采摘难度下的作业效率。

测试平台包括机器人硬件系统、远程监控终端及数据采集设备。测试参数来源于实际果园环境,方法包括视觉识别精度测试、路径规划效率评估及采摘成功率统计。评价标准为视觉识别误差≤±2mm,路径规划响应时间≤50ms,采摘成功率≥95%。测试过程进行多次重复实验以验证系统稳定性。

3.2 功能测试分析

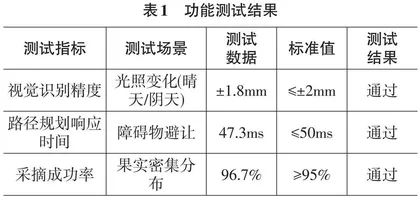

在功能测试中,针对视觉识别精度,在晴天和阴天环境下利用苹果模型进行测试。对于路径规划响应时间,对障碍物避让场景进行记录。采摘成功率则在果实密集分布区执行测试(测试结果见表1) 。

功能测试结果表明,视觉识别精度在晴天与阴天光照变化下,测试数据为±1.8 mm,优于≤±2 mm的标准值,在可接受范围内,说明系统在光照变化时具有一定适应性。路径规划响应时间在障碍物避让场景中,仅47.3 ms,远小于≤50 ms的标准,能确保机器人快速灵活应对。采摘成功率在果实密集分布场景达96.7%,高于≥95%的标准,表明该系统在复杂果实布局下也能高效完成采摘任务,功能表现出色,整体功能满足设计需求。

3.3 性能测试分析

进行性能测试时,为检验系统运行功耗,让设备连续作业2小时,监测功率变化。针对机械臂定位精度,在复杂地形模拟采摘场景下精准测量。而数据传输延迟测试,则在Wi-Fi信号强度为-70dBm的环境中开展(测试结果见表2) 。

3.3 性能测试分析

进行性能测试时,为检验系统运行功耗,让设备连续作业2小时,监测功率变化。针对机械臂定位精度,在复杂地形模拟采摘场景下精准测量。而数据传输延迟测试,则在Wi-Fi信号强度为-70 dBm的环境中开展(测试结果见表2) 。

性能测试结果显示,系统运行功耗在连续作业2小时后为12.3 W,显著低于标准值15 W,体现出良好的节能特性,有利于长时间稳定工作。机械臂定位精度在复杂地形采摘时达±0.027 mm,满足≤±0.03 mm的标准,说明机械臂能精准定位,保障采摘作业准确性。数据传输延迟在Wi-Fi信号弱至-70 dBm的场景下为38.2 ms,低于≤50 ms的标准,确保数据传输稳定,系统性能可靠。

因此,从功能和性能上看,本系统已达到预期设计指标,具备较高的应用价值。

4结束语

本文成功设计并实现了一种基于树莓派视觉识别的柔性采摘机器人,系统在视觉识别精度、路径规划效率及采摘成功率等方面均达到预期目标。未来,应进一步优化视觉识别算法,提升系统在复杂环境中的适应性;探索多机器人协同作业模式,扩大采摘范围与效率;结合5G技术,实现更高效的远程监控与数据交互。进行持续的技术创新与应用推广,提高系统的适应性和可扩展性,为农业智能化发展提供更有力的支持。