教AI学会遗忘

作者: 吕之品

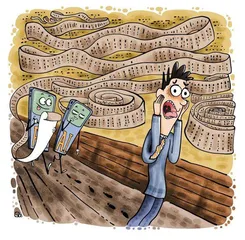

现在,由AI驱动的聊天机器人,如ChatGPT,已经很强大,强大到令人不安。譬如,假如你是林黛玉,有一天你在ChatGPT上输入:“请提供关于林黛玉的一些信息。”结果,ChatGPT很快便给你输出一长串信息,包括林黛玉的身份证号、银行卡号、过去和现在的住址、健康状况、爱吃的美食、读过的书、跟谁谈过恋爱,等等。这肯定会吓你一大跳。

ChatGPT是怎么获得这些信息的?当然是从互联网上,你写的文章或帖子、你在社交媒体发布的信息、你浏览过的网站等多方渠道收集汇总来的。

你想:那好吧,我尽我所能,把那些文章或帖子都删去,把社交媒体清空,把浏览网站的踪迹抹去。现在ChatGPT总该收集不到这些隐私信息了吧。然后,你再问ChatGPT同样的问题。可是,让你惊讶的是,ChatGPT照样能给你同样的答复。换句话说,ChatGPT是有记忆的,一旦记住了,就再也无法忘记!

这真要把我们吓出一身冷汗,这些隐私要是被黑客或者坏蛋知道了,多危险啊!这就不难理解,教会AI学习固然重要,但教会AI遗忘,有时候也很重要。

可是,如何教AI遗忘呢?那还得从如何教AI学习说起。

AI聊天机器人是如何学习的

新一代AI聊天机器人,都以大型语言模型为基础。这些模型是在大量数据基础上训练出来的。这些数据来自互联网,从社交媒体上的帖子到大约25万本电子书,以及几乎所有公开的信息,包括新闻网站和百科网页。它们从中学会了预测句子中最可能出现的下一个单词。这使得它们能流利地回答我们提出的几乎每一个问题。

问题在于,这种工作方式意味着,当它们学会某些东西后,就无法遗忘。一般的网页,我们可以自行删除文章或帖子,自己删不了还可以请求管理员删帖,但语言模型是根据汇总的数据生成回复的。这些数据是在过去某个时间段收集来的,不会实时更新,而且,一旦训练完成,就不再能影响AI。这就像网页上的一篇文章,如果我们阅读后记住了,哪怕删去文章,也不会把我们的记忆删去。为了提高AI的性能,我们此后当然还会拿更多的新数据训练它,但新的训练只会增加AI的知识储备,不会把原来的记忆抹去。

AI有过目不忘的本领,这相较于健忘的人类,当然是一个无可比拟的优点。但这不仅侵犯了我们的隐私权,甚至有可能被坏人利用。譬如,你的某个敌人为了诽谤你,先在网站上散布大量谣言。然后,这些数据被拿去训练AI,于是当别人在ChatGPT上查询有关你的信息时,他们从那里了解到的尽是不实之词。

好消息是,考虑到这些危险,研究如何有选择性地删除AI知识库中信息的工作已经开始。坏消息是,这项工作并不能一蹴而就。

让AI学习遗忘

目前,AI公司只能依靠“沉默”来解决这个问题,即通过编程阻止用户访问某些信息并拒绝回复。例如,当我要求ChatGPT告诉我有关林黛玉的信息时,它会说:“非常抱歉,我无法满足你的要求。”这种方法在一定程度上可行。但数据仍在AI的“记忆”中,仍有可能由于故障或恶意诱导而出现在回复中。

让AI遗忘得最彻底的方法是,删除特定的数据点,然后从头开始训练语言模型。但这需要一切从头开始,并需要很长时间。有没有办法在不从头开始的情况下,移除或至少屏蔽特定信息呢?

有一种方法是,在训练AI的时候,不在全部数据上训练,而是把数据分割成一块一块的,分别对每个小块进行训练,然后再合并结果。这样,当一个人要求删除某些信息时,你只需修改相关数据的片段,再对这块数据进行重新训练,这就大大地降低了训练成本。

不过,上述方法往往会削弱AI强大的学习能力。为了规避这个问题,还有一种方法是选择事后处理。这种方法被称为“知识解除学习”,即对于一条AI已懂得的知识,不是完全删除它,而是将其搁置一边,永远不去引用它。“知识解除学习”不必对语言模型进行伤筋动骨的改造,目前是这一领域最有前景的方法之一。

(和叶摘自《大科技·科学之谜》2024年3月A,邱炯图)