基于机器视觉的酿酒葡萄叶幕厚度估算方法研究

作者: 马聪 陈学东

摘要 酿酒葡萄叶幕厚度是园区管理、整形修剪、变量喷药等作业的重要参考依据,但是监测叶幕厚度存在作业量大、效率低、劳动强度高等问题。以贺兰山东麓酿酒葡萄叶幕为目标,基于机器视觉技术研究叶幕厚度的快速估算方法并进行验证。采集葡萄叶幕双目图像及参数,基于HSV颜色空间和形态学处理方法提取左目图像叶幕部分,将提取的图像与右目图像进行校正,采用BM算法对校正后的图像进行立体匹配,计算叶幕范围内所有像素点的三维坐标,依据z值平均值和园区参数计算叶幕厚度估算值。经测试,提出的叶幕厚度估算方法计算结果与实际测量值基本一致,满足酿酒葡萄园实际管理应用监测需求,可为研发叶幕厚度快速测量设备、推进园区管理精细化提供一定的理论基础。

关键词 酿酒葡萄;机器视觉;叶幕厚度;立体匹配

中图分类号 S126 文献标识码 A 文章编号 0517-6611(2024)15-0232-04

doi:10.3969/j.issn.0517-6611.2024.15.049

开放科学(资源服务)标识码(OSID):

Research on the Estimation Method of Canopy Thickness of Grapevine Based on Machine Vision

MA Cong, CHEN Xue-dong

(Institute of Agricultural Economy and Information Technology, Ningxia Academy of Agriculture and Forestry Sciences, Yinchuan, Ningxia 750002)

Abstract The canopy thickness of grapevine is an important reference for vineyards management, shaping and pruning, variable spraying and other operations. However, monitoring the canopy thickness of grapevine has problems, such as high workload, low efficiency and high labor intensity. We focused on the canopy thickness of grapevine from the east Helan Mountain area, and used machine vision technology to study and validate a rapid estimation method for canopy thickness. We collected binocular images and parameters of canopy, extracted the canopy part of the left image based on HSV color space and morphological processing methods, corrected the extracted image with the right eye image, used BM algorithm to perform stereo matching on the corrected image, calculated the three-dimensional coordinates of all pixel points within the leaf canopy range, and calculated the estimated canopy thickness of grapevine based on the average z value and fixed parameters. After testing, the calculation results of the thickness estimation method proposed were basically consistent with the actual measurement values. It could provide a certain theoretical basis for the development of thickness measurement equipment and promoting the refinement of park management.

Key words Grapevine;Machine vision;Canopy thickness;Stereo matching

因地理条件和环境气候非常适合种植酿酒葡萄,宁夏贺兰山东麓葡萄是国家地理标志农产品,生产的宁夏葡萄酒在消费市场上的知名度和需求量快速提升,是我国优质的酿酒葡萄产业区之一。预计到2025年,新增酿酒葡萄种植基地3.39万hm2,规模达到6.67万hm2[1-3]。随着酿酒葡萄种植面积规模化和人工成本的增加,通过机械化、信息化的手段对酿酒葡萄生产环节进行监测、分析、预警、作业,以降低劳动强度、提高生产效率,成为产业发展的重要方向。

酿酒葡萄的叶幕管理是葡萄园种植生产的重要内容。叶幕结构合理,则植株的光合效率高,有利于提升葡萄果实的品质和产量。不同的叶幕厚度会影响植株营养分配、酿酒葡萄的果实形成和生长,是叶幕管理的关键参数。葡萄叶幕过厚,会导致树体郁闭,降低叶幕的通风性和透光性,也会抑制葡萄的生殖生长;葡萄叶幕过薄,则光合作用制造的能量不足,影响葡萄正常生长[4-5]。叶幕厚度是葡萄园管理、机械整形修剪[6-8]、变量施药[9-10]等作业的重要参考依据,但是由于葡萄园区面积大、劳动力紧缺、测量耗时费力,较难实现叶幕厚度的实时测量和监测。针对叶幕厚度估算的需求,需要研究能快速估算葡萄叶幕厚度的方法。采用机器视觉技术[11-12]开展了叶幕厚度估算方法研究,以期为酿酒葡萄叶幕信息化管理提供参考,为进一步完善葡萄园信息化应用奠定一定的理论基础。

1 叶幕厚度估算方法

1.1 技术路线

酿酒葡萄叶幕厚度估算主要技术路线如下:标定双目相机后获取相机内部和外部参数,采用标定后的双目相机采集酿酒葡萄叶幕图像,将双目图像分割后提取左目图像目标区域,对提取后的图像与左图进行极线校正以保证2幅图像上对应的点具有相同的行号,校正后的双目图像通过BM(blocking matching)算法[13-15]进行立体匹配,得到像素点的视差值,根据视差深度换算公式计算目标区域各点的空间三维坐标,结合葡萄园实际测量参数,获得叶幕参数估计值。

1.2 数据采集

1.2.1 相机标定。

数据采集设备是高帧率双目相机,基本配置为:40 mm基线,3.6 mm无畸变镜头,USB 3.0连接电脑控制拍照。相机标定采用机器视觉系统常用的张正友标定法,具有标定方法简单、操作灵活、标定结果可靠等优点。双目相机标定结果见表1。

1.2.2 数据采集。

数据采集地点位于宁夏贺兰山东麓酿酒葡萄种植基地,采集叶幕数据的酿酒葡萄品种是西拉。酿酒葡萄采用篱架式种植,行间距3.2 m,株距0.8 m,每行立柱之间有多层双行铁丝固定枝蔓,两行铁丝之间的距离为0.17 m,叶幕高度约0.8 m。

该研究首先构建了田间图像采集机器视觉数据采集系统,主要包括双目相机、采集支架、环境监测传感器、测距卡尺、图像采集软件和数据处理系统等。根据实际监测需求,采集了不同时间段、多个角度、不同光照条件下的葡萄叶幕双目图像,数据采集时相机随机处于叶幕不同距离位置,图像采集范围为相机有效视野范围内葡萄叶片覆盖区域,实地测量相机平面到葡萄叶幕最厚位置的距离、相机平面到立柱固定铁丝内侧距离、内侧铁丝到叶幕最厚位置的距离。采集到的图像左目图像为彩色图像,右目图像为灰度图,数据处理均以左目图像为基准。

1.3 叶幕厚度估算

1.3.1 目标区域提取。

叶幕图像包括了背景图像与目标图像,背景图像包含了地面、通风带及天空等干扰因素。为提高图像处理效率、准确获取目标信息,通过图像处理将目标与背景分割,最大限度降低采集环境对目标识别的影响。分析采集的叶幕图像可知,自然光照条件下顺光和逆光拍摄的葡萄叶幕图像颜色没有太大区别,叶幕区域基本都是绿色。在光照强度较大的条件下逆光拍摄时,部分叶片由于反光趋近于白色,但是这部分为一小部分叶片,不影响叶幕整体区域整体识别结果。叶幕颜色与背景区域颜色差异较大,采用颜色模型进行目标区域提取能有效地分离出目标区域,也可以降低图像数据处理的计算量。

该研究采用HSV(hue,saturation,value)颜色模型提取叶幕图像目标,为保证最大限度完整地分割出叶幕区域,将颜色分割阈值范围扩大,包括青绿色、黄绿色、深绿色等范围内所有目标。基本计算流程如下:读入双目图像,分割出左目图像与右目图像;将左目图像转换为HSV模型,建立与左图大小一致的空白图像,分别设置H、S、V阈值;遍历左目图像所有像素点,提取阈值范围内图像点复制到建立的空白图像对应位置,阈值范围外的图像点均设置为黑色;将提取区域进行形态学处理,设置连通域阈值,存在大于阈值的连通域图像被判断为存在目标区域;针对存在目标区域的图像,腐蚀去除图像小的噪声;对目标区域图像进行膨胀操作,最大化的保留原图信息,避免因光线不均和拍摄角度变化导致出现叶幕区域提取不完整、碎片化现象;以处理后的区域图为蒙版,提取校叶幕左图原图中对应区域,即叶幕区域。

1.3.2 双目图像校正。

理论条件下,双目相机的2个镜头光心是完全相互平行的,采集到的左目图像与右目图像中对应点具有一致的行号。但是在应用中,由于震动、装配工艺、环境变化等因素,实际采集到的双目图像很难达到上述标准,2幅图像上的对应点不在同一条直线上。因此,在进行2张图像中对应点匹配查找时,需要在整幅图像中进行遍历搜索,数据计算量大、运行消耗时间长,不利于机器视觉系统的实时计算。为了提高对应点的查找效率,需要对双目图像进行数学校正,使2幅图像中对应点具有相同的行号,极大地提高对应点匹配速度和准确性。采用极线约束Bouguet校正算法[16-17]对目标区域提取图和右目图像进行校正,基本计算流程如下:读取双目相机标定出内部参数和外部参数;计算左目和右目相机的旋转矩阵和投影矩阵;将原图像和校正后图像上的点进行映射;分析图像校正结果。

1.3.3 立体匹配。

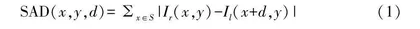

针对葡萄图像的面积大、纹理不明显的特点和深度计算精度需求,采用局部立体匹配算法中的块匹配BM(block matching)算法进行叶幕图像的匹配计算。基本计算流程如图1所示:①读入双目图像,将彩色图像转换为灰度图;②根据匹配计算速度和精度需求,设置匹配窗口大小和视差范围;③分别计算匹配窗口内双目图像中的所有像素点灰度值;④以SAD(sum of absolute differences)函数计算窗口内像素点的相似性,SAD的计算公式见公式(1)[18];⑤判断SAD值是否最小,是最小值则表明找到最佳匹配点,不是最小值则匹配窗口按照极线方向在右目图像中移动,重复步骤③~⑤,直到找到最佳匹配点为止。

SAD(x,y,d)=x∈S|Ir(x,y)-Il(x+d,y)|(1)

式中:S为BM算法匹配窗口;Ir(x,y)为右目图像像素点灰度值;d为左右目图像像素点视差值;Il(x+d,y)为左目图像像素点灰度值。

1.3.4 叶幕厚度估算。

通过立体匹配计算获得了双目图像所有像素点对应的视差值,根据视差值、相机内部参数、相机外部参数,计算得到图像内所有像素点的空间三维坐标值,计算公式见公式(2)。

z=f×bd(2)

式中:z为深度距离;f为双目相机焦距;b为双目相机基线值;d为双目图像中对应点的视差值。