作物表型巡检机器人实验平台设计与教学应用

作者: 邱小雷 张小虎 李彦 周栋

[摘 要] 针对智慧农业类专业缺乏地面自主作物表型巡检教学设备,基于机器人操作系统(ROS)设计了一款以轮式底盘为载体的小型自走式作物表型巡检机器人实验平台。该平台搭载了深度相机、RGB相机和多光谱相机等表型监测模块,激光雷达、深度相机、RTK定位设备、IMU传感器等辅助驾驶模块,具备通用性、综合性和开放性等特点。通过基础实验和创新实验的教学应用,能够培养学生的动手实践能力、系统综合设计能力及创新思维、科研思维。该平台的开发和应用不但促进了学生实践技能的培养,而且在智慧农业技术示范推广中取得了较好效果。

[关键词] 作物表型巡检机器人;机器人操作系统;实验教学平台;实践教学

[基金项目] 2023年度中央高校基本科研业务费专项资金资助“作物表型巡检机器人实验教学平台的构建”(SYS2023001);2024年度教育部产学合作协同育人项目“数字孪生与人工智能技术在智慧农业专业建设中的应用”(231104822160457);2024年度教育部产学合作协同育人项目“基于数字孪生与人工智能技术的‘信息农业技术’课程改造研究”(231104822154512)

[作者简介] 邱小雷(1982—),男,河南焦作人,硕士,南京农业大学农学院高级实验师,主要从事智慧农业技术、实验实践教学研究;张小虎(1986—),男,江苏扬州人,博士,南京农业大学农学院副教授(通信作者),主要从事农业大数据研究。

[中图分类号] TP391;G642.0 [文献标识码] A [文章编号] 1674-9324(2024)39-0021-04 [收稿日期] 2024-01-12

作物表型是作物基因与环境相互作用产生的部分或全部可辨识的物理、生理和生化特征及性状[1],包括作物的形态结构、营养组分、生长特征、病虫害胁迫和生产力等类型。作物表型信息是揭示作物生长发育规律及其与环境关系的重要依据,是智慧育种、智慧农作的前提和基础。“天空地网”立体化的作物表型信息监测技术近年来取得了突破性进展[2]。掌握相关技术是智慧农业类专业不同层次学生必备的技能。

目前,卫星遥感、无人机、物联网等监测平台和实验教学资源相对成熟,而将数字仪器、传感器集成到地面机器人的高通量表型采集设备,由于技术较新、发展较快,针对性的配套实验和资源尚薄弱。为此,本文设计了一款以轮式底盘为载体的小型自走式作物表型巡检机器人实验平台,其具有丰富的传感器和自主作业等优点,续航时间较长,具有良好的稳定性,易于控制,易于扩展,且价格便宜,是理想的作物表型信息采集工具和教学实验平台。

一、实验平台软硬件设计

(一)机器人硬件系统设计

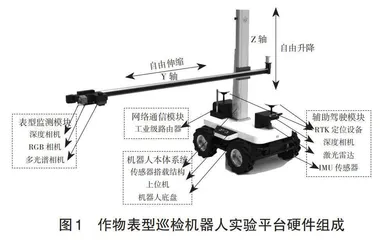

作物表型巡检机器人的硬件系统是实验平台的基础,如图1所示主要有四部分,分别为机器人本体系统、辅助驾驶模块、表型监测模块、网络通信模块。

1.机器人本体系统。机器人本体系统包括机器人底盘、传感器搭载结构和上位机。机器人底盘选择了四轮差速移动平台,搭载以ARM® Cortex®-M4为内核的高性能微控制器STM32F4,底盘能实现原地转向。最大行驶速度为1.48 m/s,最大载重为100 kg,最大续航为5 h。传感器搭载结构使用STM32F1控制板,结构分为直线驱动机构和旋转驱动机构,直线驱动机构选用滚珠丝杠导轨实现表型监测模块在垂直方向(Z轴)的自由升降,最高可升至1.4 m;选用同步带导轨实现表型监测模块水平方向(Y轴)的自由伸缩,最大可伸长2 m。上位机使用安装Ubuntu系统和ROS机器人操作系统的工控机,作为ROS主节点负责管理调度网络中节点与节点之间的通信,同时用于配置网络中的全局参数和保存采集数据。

2.辅助驾驶模块。辅助驾驶模块包括激光雷达、深度相机、RTK定位设备和IMU传感器等,用于辅助机器人运动状态调整和行驶导航。选用杉川3i-T1单线激光雷达和乐视LeTMC-520深度相机组合实现机器人作业环境的实时感知与视觉避障,所选激光雷达探测距离为20 m,能精准获取所在空间平面点云信息;所选深度相机集成MT9M001和AR0330CMOS图像传感器,可以获取彩色图像、深度图像及红外图像。RTK定位设备选用飞纳经纬MINI2-D定位定向接收机,支持BDS、GPS、GLONASS、QZSS系统RTK高精度定位。IMU使用了灵遨科技的六轴惯性测量传感器,其整合三轴加速度计、三轴陀螺仪传感器,能提供包括欧拉角、四元数和加速度等信息在内的精确数据。

3.表型监测模块。表型监测模块是机器人实验平台的核心,由深度相机、RGB相机和多光谱相机等传感器组成,实现作物表型多源数据的采集。深度相机同为乐视LeTMC-520体感摄像头,作为第一深度相机获取作物冠层深度图像。RGB相机以Sony IMX179为感光元件,最高有效像素800万,适合多种环境拍摄。多光谱相机选用RedEdge-M,可同时获取蓝色、绿色、红色、红色边缘、近红外五个不连续的光谱图像。表型监测模块装置于传感器搭载结构Y轴导轨终端相机集成箱,理论承载最大重量设计为21.1 kg。集成箱体设置了分控板,能满足多种类型传感器的自主集成。还设置了一个舵机,可实现RGB相机多角度自由旋转。

4.网络通信模块。工业级路由器选用汉枫4G无线路由器HF8104,支持4G、Wi-Fi、以太网等通信方式。路由器的主要作用:一是将上位机、激光雷达、多光谱相机、RTK定位设备组成内部局域网,实现上位机的信息采集;二是户外工作时为RTK定位设备提供移动网络;三是满足服务器或PC终端与上位机通信交互,向上位机下发作业指令或将上位机中采集的信息传输至本地。

(二)机器人控制系统设计

机器人控制系统是机器人的大脑,是决定机器人功能和性能的主要因素。作物表型巡检机器人控制系统分为上位机主控、下位机主控、传感器搭载结构主控三个模块。上位机主控即工控机,是ROS机器人操作系统的载体,接入工业路由器,然后通过USB接口、有线网络或无线网络接入深度相机、RGB相机、激光雷达、RTK定位模块、多光谱相机,通过RS232串口与下位机通信。下位机主控的核心为STM32F4运动控制板,主要实现对机器人底盘的运动控制,对电机及其他外设的控制,通过RS485串口与传感器搭载结构通信。传感器搭载结构主控是STM32F1控制板,实现对Z轴伺服电机控制升降Y轴;通过RS485与相机集成箱的中继控制板通信,实现对相机集成箱Y轴方向的移动控制,以及对RGB相机多角度旋转的控制。

(三)人机交互系统设计

人机交互系统是人与机器之间进行消息传递的媒介,常用方式包括文本指令、图形界面、语音识别等,帮助使用者简易、快捷地操纵机器完成各项作业。本文采用Python与C++混合编程形式,使用PyCharm和Qt Creator编译器,基于ROS设计PC端作物表型巡检机器人交互系统,利用ROS的话题通信机制与服务通信机制、Qt的信号与槽机制,开发设备连接、节点启动、运动控制、传感器姿态控制、自主导航、点云显示、图像订阅、图像存储、表型监测等核心功能,实现对机器人控制与数据采集管理的一体化。

二、实验平台创新实验设计

基于ROS的作物表型巡检机器人实验平台,提供了一个开放性的软硬件实验环境。学生不但能够在平台上实践机器人基本控制原理与方法、传感器数据采集和作物表型参数反演,还可以自主探索创新实验,例如实践路径规划与自主导航、作物叶绿素监测和作物穗数识别等拓展功能。

(一)实验平台基础实验设计

实验1:机器人控制实验。机器人控制实验包括设备初始化、运动控制和传感器姿态控制。首先将安装人机交互系统的便携式电脑作为控制终端,联网到机器人工业路由器,配置分布式多机通信使其通过SSH与上位机远程连接,然后基于节点启动工具roslaunch和SSH协议,远程执行机器人底盘和升降臂、导航、RGB相机、深度相机等节点的启动。运动控制是利用上位机ROS订阅控制终端发布的速度、方向控制话题,然后向下位机主控STM32 F4发送指令,其对运动模型进行解算,控制四个车轮电机,实现机器人不同速度的前进、后退和转向。传感器姿态控制是通过设置Y轴、Z轴的位置,RGB相机旋转角度、运行速度等参数,由STM32 F1控制板控制伺服电机与舵机,实现表型监测模块的移动和RGB相机的旋转。

实验2:传感器数据采集实验。传感器数据采集实验是实践作物表型巡检机器人的激光雷达、深度相机、RGB相机等传感器的实时监测与信息采集功能。通过在Qt中导入RViz组件实现激光雷达点云数据的可视化;利用ROS的图像传输包image_transport、可视化包image_view与OpenCV结合,实现RGB图像与深度图像的可视化和采集存储。区别于利用ROS连接传感器,多光谱相机RedEdge-M提供了网络界面,并支持时间触发、重复率触发和外部触发,可使用控制终端Wi-Fi连接多光谱相机,基于HTTP实现五个通道的图像数据预览、捕获与存储。

实验3:作物叶面积指数反演实验。利用Python脚本对保存至控制终端的多光谱传感器数据、RGB相机数据进行预处理、数据配准,提取多光谱植被指数、可见光植被指数和纹理特征,并将提取的特征值进一步传入基于多传感器融合的水稻叶面积指数监测模型,可实现水稻叶面积指数的估测,展示数据级融合后的RGB图像和各植被指数、纹理特征的分布图(如图2所示)。本实验以水稻叶面积指数监测模型为例,学生实验时,可以根据平台提供的源码,使用自建模型替换,尝试不同作物叶面积指数反演。

(二)实验平台创新实验设计

实验1:路径规划与自主导航实验。作物表型巡检机器人集成了激光雷达、深度相机、RTK定位、IMU、轮子里程计等传感器或模块,学生可利用实验平台自行完成路径规划与自主导航实验。例如密闭环境下的SLAM(Simultaneous Localization and Mapping)实验,使用gmaping包订阅机器人深度相机信息、IMU信息和里程计信息,创建二维栅格地图,然后使用move_base、amcl等包实践路径规划、自动避障和自主导航。再如户外RTK循迹导航实验,首先在野外或田间人工控制机器人完成作业轨迹,将RTK、IMU与里程计的数据融合定位,获取并保存机器人作业路径;然后实践机器人加载已知路径,并完成指定路径行走作业、局部路径规划避障和自主导航等。

实验2:作物叶绿素监测实验。叶绿素状况是作物营养胁迫、光合能力和衰老进程的良好指示剂,实时无损监测作物叶绿素对作物生长诊断、产量估算及氮素管理具有重要意义,也是智慧农业关键技术和学生必备的技能。该实验的基础是农业遥感原理与技术,已有大量研究关于多光谱影像构建常用植被指数、监测作物叶绿素含量的模型和方法[3-4]。学生可基于作物表型巡检机器人与集成的多光谱相机,参考现有文献资料并与上述实验结合编写算法代码,实践利用机器人自主完成田间作物叶绿素监测工作。

实验3:作物穗数识别实验。作物穗数是产量构成的重要因素,已有大量通过图像处理技术快速准确识别小麦、水稻等作物穗数的研究工作[5-6],为作物长势监测和产量估测提供了重要依据。作物穗数识别是一个综合性创新实验,其基础工作是图像分割,常用阈值分割法、边界检测法、聚类分割法、区域生长法等传统方法和基于深度学习的语义分割方法,需要学生具备图像识别、深度学习等基础,然后在作物表型巡检机器人实验平台上,探索田间作物穗数自动识别操作。

结语

本文以南京农业大学智慧农业专业建设为契机,面向本科和研究生不同层次人才培养需求,基于ROS进行了作物表型巡检机器人实验平台开发和实验教学设计。学生通过基础实验和创新实验,不仅可以夯实“程序语言设计”“农业传感器与智能装备”“农业遥感原理与技术”“农业人工智能与机器学习”等核心课程的专业知识,而且可以帮助学生将所学知识融会贯通,实现自主探究学习,还可以提高学生的动手实践和系统综合设计能力,培养创新思维和科研思维。作物表型巡检机器人实验平台的设计开发与教学应用,除了在实践教学中取得了满意效果,在智慧农业技术应用推广中也获得较好的示范效应[7]。

参考文献

[1]SADRAS V, REBETZKE G, EDMEADES G. The phenotype and the components of phenotypic variance of crop traits[J]. Field crops research,2013,154:255-259.